复制下方链接至浏览器免费试用GPT4.0

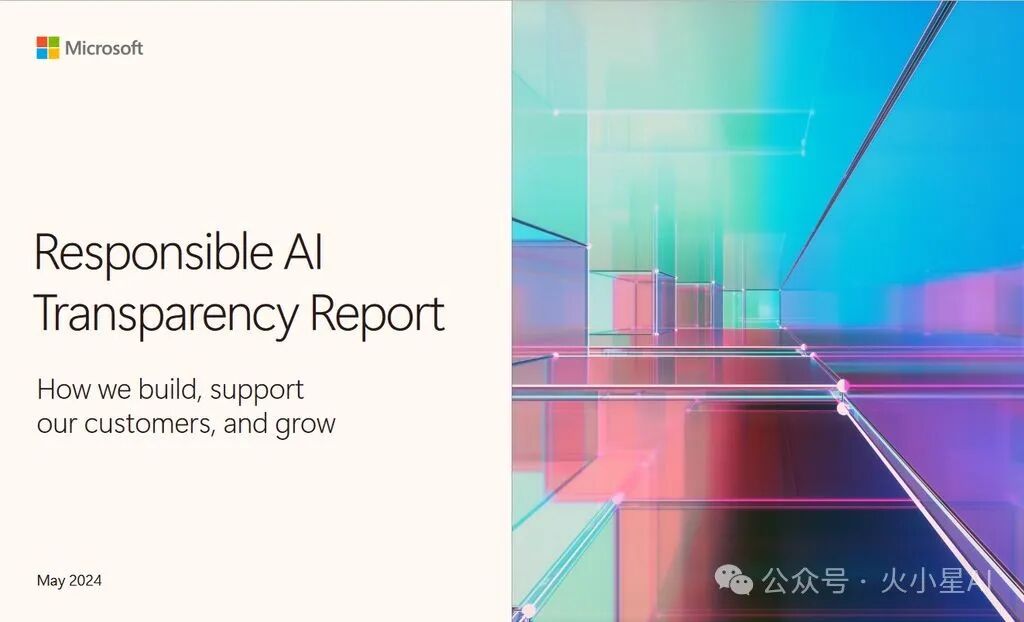

微软公司近期公布了其最新的透明度报告,这份报告详细梳理了公司在2023年所制定和实施的一系列举措,旨在以更加负责任的态度发布各类生成式产品。

这一系列的努力旨在确保产品的质量和安全性,同时体现了微软对于用户和社会的高度责任感。

微软在2023年7月自愿签署了一项协议,承诺将每年定期发布人工智能透明度报告,旨在构建并维护一个负责任、健康且安全的人工智能系统。

在最新发布的《负责任的人工智能透明度报告》中,微软详细介绍了其在安全部署人工智能产品方面所取得的显著成就。

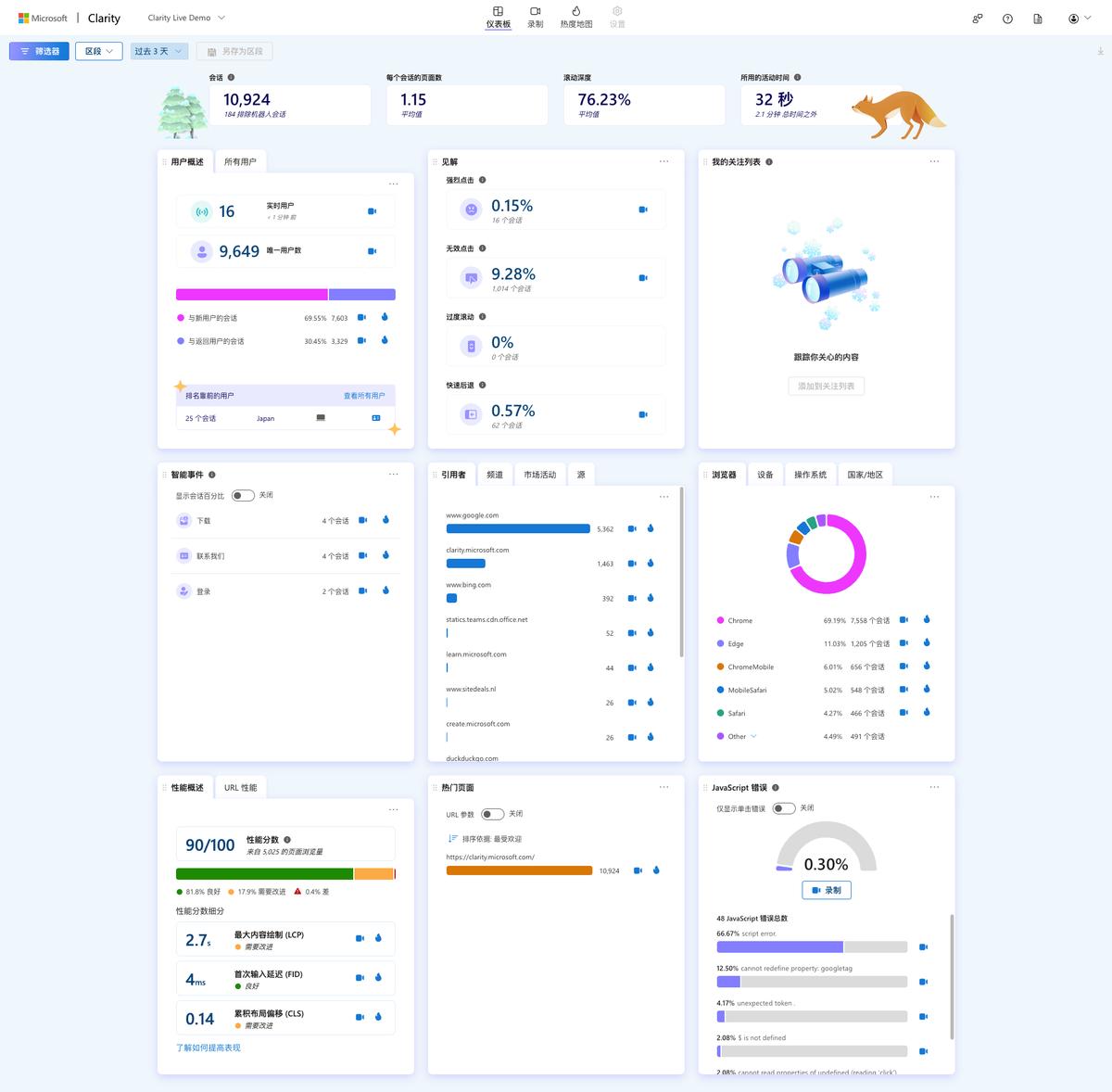

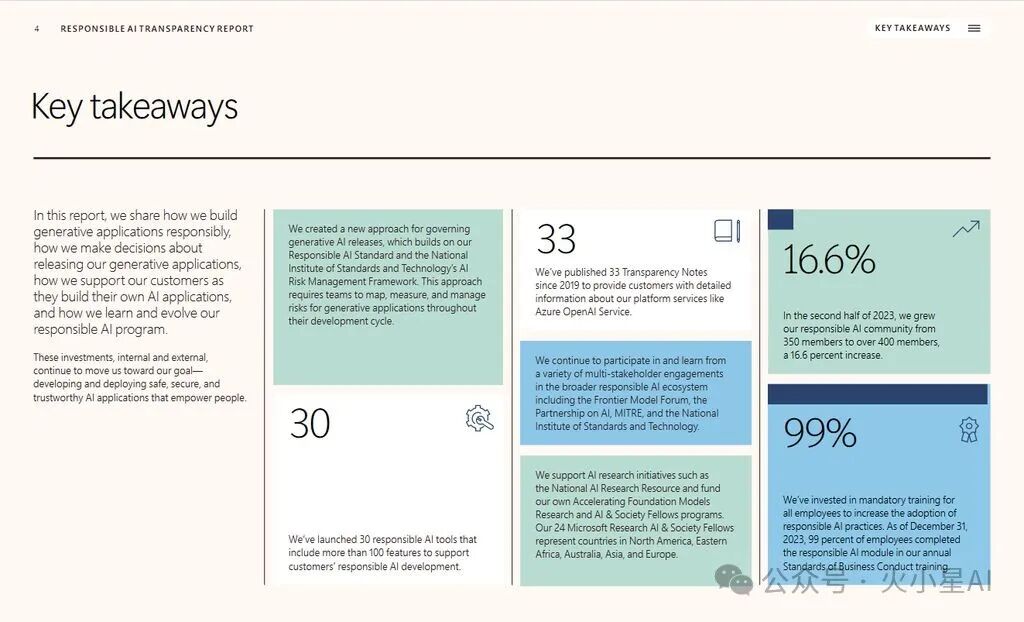

公司成功创建了30个专注于负责任的人工智能工具,进一步扩大了其负责任的人工智能团队,并严格要求开发生成式人工智能应用程序的团队在整个开发过程中进行风险评估和监测。

这些举措彰显了微软对于确保人工智能产品安全性、可靠性和道德性的坚定承诺。

微软公司强调,在其图像生成平台上,已经引入了内容凭证功能,该功能通过在照片上添加水印的方式,明确标识这些图片是由其先进的人工智能模型生成的。

此外,微软还表示,Azure AI 的客户现在可以利用一系列工具来检测并过滤仇恨言论、性内容以及自残等敏感信息,同时还提供了评估潜在安全风险的工具。

这些工具不仅提升了用户体验的纯净度和安全性,也为企业客户在构建基于人工智能的解决方案时提供了额外的保护。

为了确保人工智能模型的稳定性和安全性,微软正加大其在红队(渗透测试团队)工作方面的投入。

这包括内部红队,他们负责故意尝试绕过人工智能模型中的安全功能,以发现潜在的漏洞。

同时,微软还推出了红队应用程序,允许第三方在发布新模型之前进行独立的测试,从而进一步确保模型的健壮性和可靠性。

© 版权声明

文章版权归作者所有,未经允许请勿转载。

相关文章

暂无评论...