总起:想训大模型?先摸摸钱包和头发

训练一个大语言模型(LLM),就像养一只吞金兽——吃得比大象多,拉得比码农慢,还会学你骂人。

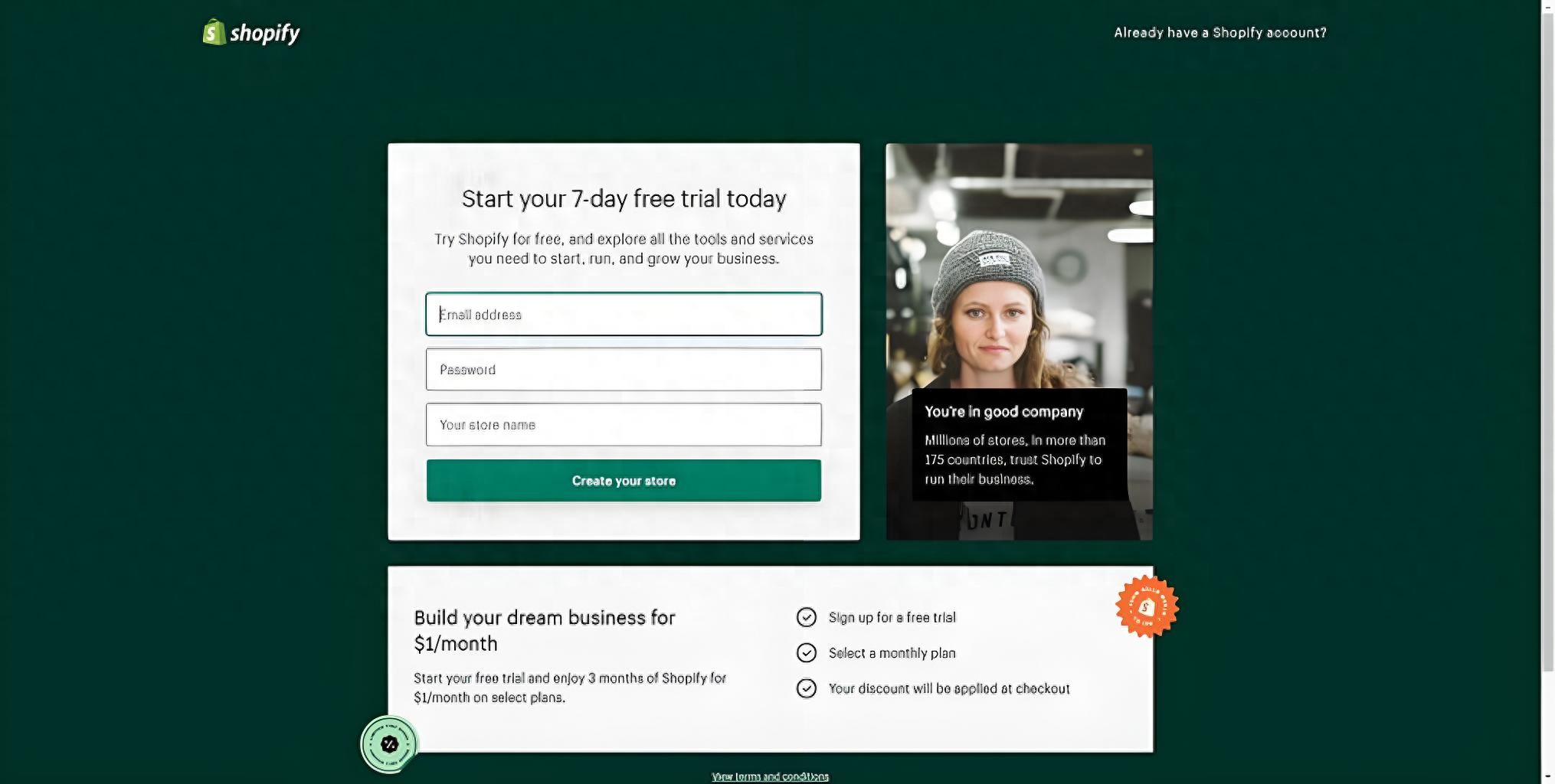

UTC最新报告泼冷水:从零训个GPT-3?先备好2.3亿美金+288年单卡时间+一吨防脱洗发水!但别慌,这篇“求生指南”教你避坑、省钱、保住发际线!

分述:五大狠招,从“小白”到“模型大佬”1.硬件:烧钱就像烧纸

显卡堆成山:GPT-3用了上万张V100,如今A100是起步价。建议改名“A100收割机”。

并行计算是玄学:数据并行、张量并行、流水线并行……听着像火锅吃法,实际是“显卡烧烤架”。

省钱tip:租云服务器?记得买“包年包秃头”套餐。

2.数据:不是“喂”得多就能胖

数据集要“满汉全席”:代码、论文、小说、弹幕都得有,不然模型只会说“呵呵”或“404”。

去重比减肥难:重复数据像薯片渣——删不完还影响口感(模型性能)。

毒性过滤是道德底线:别让AI学会骂街,否则用户投诉比训练loss涨得还快。

3.训练:AI界的“坐月子”

超参数调优像摇骰子:学习率、批次大小、……组合比奶茶口味还多,选错全盘崩。

硬件故障是日常:训练到99%突然断电?建议备好救心丸和备份检查点。

收敛策略玄学大全:

“学习率先冲后躺”(线性升温再衰减)

“批次大小从S码到XXL”(逐步扩大)

“热插拔优化器”(边训边换,堪比换轮胎赛车)

4.评估:模型也得“考雅思”

考题库浩如烟海:常识推理、代码生成、翻译、数学……AI考不过高中生?正常!

零样本vs少样本:

零样本:AI裸考,结果常常“答非所问”

少样本:给点例题,立马“学霸附体”

人工评估是照妖镜:让领域专家和NLP工程师混合双打,专治模型“鬼扯”。

5.对齐:教AI“说人话”

指令调优是补习班:教模型听懂“翻译这句话”而不是“给我编段相声”。

RLHF:人类反馈驯兽术:

第一步:示范答题(模仿人类)

第二步:奖励好评(给AI发小红花)

第三步:强化学习(变成乖孩子)

注意:对齐税——模型变乖了,但性能可能微跌,就像员工听话但效率降了。

总结:自己训模型?先答三道题有钱吗?硬件千万起,电费比工资高,都肉疼。有数据吗?全网爬料+专家标注,工作量堪比给长城贴瓷砖。有耐心吗?调试3个月,训练3个月,结果——模型学会了写“404 Not Found”。

终极建议:

报告真相:

“90%的公司不需要自训模型,就像90%的人不需要自制航母——帅,但没必要。”

相关文章